Правильный файл robots.txt – 2024

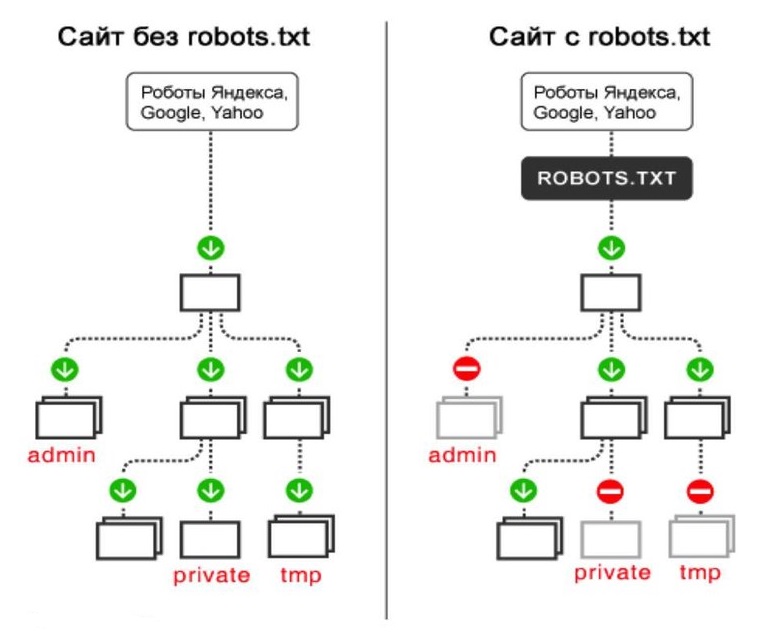

Файл robots.txt является важным элементом для управления поведением поисковых роботов на веб-сайте. Этот текстовый документ указывает, какие участки сайта должны быть доступны для индексации и поиска поисковыми системами, а какие следует исключить из сканирования.

Поисковые системы Яндекс и Google, предварительно анализируют файл robots.txt, чтобы понять, какие страницы им можно индексировать, а какие - нет. После этой проверки поисковые роботы начинают обход сайта, сканируя его содержимое, а затем архивируя и категоризируя информацию для более эффективного поиска и отображения результатов пользователям.

Таким образом, правильно настроенный файл robots.txt может помочь оптимизировать видимость вашего веб-сайта в поисковых результатах, управляя тем, какие страницы индексируются, и какие остаются скрытыми от поисковых систем.

Robots.txt - это специальный файл, который включает в себя указания для поисковых ботов о том, какие части сайта следует игнорировать при индексации. Причины для таких инструкций могут быть разными, например, владелец сайта может желать сохранить конфиденциальность определенных данных, или он может считать, что некоторая информация не должна появляться в результатах поиска, чтобы обеспечить более точное и релевантное отображение других страниц сайта.

Если у веб-сайта есть несколько субдоменов, то для каждого из них необходимо создать свой собственный файл robots.txt. Важно понимать, что не все поисковые боты обязательно будут следовать его указаниям. Некоторые злонамеренные боты даже используют его содержание, чтобы выяснить, какие файлы и каталоги вы хотите скрыть, и могут проигнорировать эти инструкции.

Кроме того, даже если в файле robots.txt указано игнорировать определенные страницы на сайте, они могут по-прежнему появляться в результатах поиска, если на них ссылаются другие уже просканированные страницы. Это связано с тем, что поисковые системы формируют свой индекс на основе различных факторов.

Стандартный файл роботс тхт для Вордпресс, например, по умолчанию открывает для индексации все разделы сайта. Поэтому важно исключить из индексации те разделы сайта, которые не должны появляться в результатах поиска.

Популярные поисковые роботы

- Googlebot — основной робот Google;

- YandexBot — основной краулер Яндекс-поиска;

- Googlebot-Image — робот картинок;

- YandexImages — робот индексации Яндекс.Картинок;

- Yandex Metrika — робот Яндекс.Метрики;

- Yandex Market— робот Яндекс.Маркета;

- Googlebot-Mobile —индексатор мобильной версии.

Готовый файл robots.txt для Wordpress – 2024

Просто скопируйте его и вставьте в свой файл роботс, заменив instaseo.ru на адрес вашего сайта.

User-agent: *

Disallow: /cgi-bin

Disallow: /?

Disallow: /wp-

Disallow: /wp/

Disallow: *?s=

Disallow: *&s=

Disallow: /search/

Disallow: /author/

Disallow: /users/

Disallow: */trackback

Disallow: */feed

Disallow: */rss

Disallow: */embed

Disallow: /xmlrpc.php

Disallow: *utm*=

Disallow: *openstat=

Allow: */uploads

User-agent: GoogleBot

Disallow: /cgi-bin

Disallow: /?

Disallow: /wp-

Disallow: /wp/

Disallow: *?s=

Disallow: *&s=

Disallow: /search/

Disallow: /author/

Disallow: /users/

Disallow: */trackback

Disallow: */feed

Disallow: */rss

Disallow: */embed

Disallow: /xmlrpc.php

Disallow: *utm*=

Disallow: *openstat=

Allow: */uploads

Allow: /*/*.js

Allow: /*/*.css

Allow: /wp-*.png

Allow: /wp-*.jpg

Allow: /wp-*.jpeg

Allow: /wp-*.gif

Allow: /wp-admin/admin-ajax.php

User-agent: Yandex

Disallow: /cgi-bin

Disallow: /?

Disallow: /wp-

Disallow: /wp/

Disallow: *?s=

Disallow: *&s=

Disallow: /search/

Disallow: /author/

Disallow: /users/

Disallow: */trackback

Disallow: */feed

Disallow: */rss

Disallow: */embed

Disallow: /xmlrpc.php

Allow: */uploads

Allow: /*/*.js

Allow: /*/*.css

Allow: /wp-*.png

Allow: /wp-*.jpg

Allow: /wp-*.jpeg

Allow: /wp-*.gif

Allow: /wp-admin/admin-ajax.php

Clean-Param: utm_source&utm_medium&utm_campaign

Clean-Param: openstat

Sitemap: https://instaseo.ru/sitemap.xml

Правильный файл robots.txt для Wordpress – 2024 (с пояснениями)

User-agent: * # общие правила для роботов, кроме Яндекса и Google, т.к. для них правила ниже

Disallow: /cgi-bin # системная папка на хостинге, закрывается всегда

Disallow: /? # все параметры запроса на главной

Disallow: /wp- # все файлы WP: /wp-json/, /wp-includes, /wp-content/plugins

Disallow: /wp/ # если есть подкаталог /wp/, где установлена CMS (если нет, правило можно удалить)

Disallow: *?s= # запрос поиска

Disallow: *&s= # запрос поиска

Disallow: /search/ # запрос поиска

Disallow: /author/ # архив автора, если у Вас новостной блог с авторскими колонками, то можно открыть

# архив автора, если у Вас новостной блог с авторскими колонками, то можно открыть

Disallow: /users/ # архив авторов

Disallow: */trackback # трекбеки, уведомления в комментариях о появлении открытой ссылки на статью

Disallow: */feed # все фиды

Disallow: */rss # rss фид

Disallow: */embed # все встраивания

Disallow: */wlwmanifest.xml # xml-файл манифеста Windows Live Writer (если не используете, правило можно удалить)

Disallow: /xmlrpc.php # файл WordPress API

Disallow: *utm*= # ссылки с utm-метками

Disallow: *openstat= # ссылки с метками openstat

Allow: */uploads # открываем папку с файлами uploads

# Укажите один или несколько файлов Sitemap (дублировать для каждого User-agent

# не нужно). Google XML Sitemap создает 2 карты сайта, как в примере ниже.

Sitemap: http://instaseo.ru/sitemap.xml

Sitemap: http://instaseo.ru/sitemap.xml.gz

# Host прописывать больше не нужно.

Расширенный вариант для Wordpress - разделенные правила для Google и Яндекса (с пояснениями)

User-agent: * # общие правила для роботов, кроме Яндекса и Google, т.к. для них правила ниже

Disallow: /cgi-bin # папка на хостинге

Disallow: /? # все параметры запроса на главной

Disallow: /wp- # все файлы WP: /wp-json/, /wp-includes, /wp-content/plugins

Disallow: /wp/ # если есть подкаталог /wp/, где установлена CMS (если нет, правило можно удалить)

Disallow: *?s= # поиск

Disallow: *&s= # поиск

Disallow: /search/ # поиск

Disallow: /author/ # архив автора

Disallow: /users/ # архив авторов

Disallow: */trackback # трекбеки, уведомления в комментариях о появлении открытой

# ссылки на статью

Disallow: */feed # все фиды

Disallow: */rss # rss фид

Disallow: */embed # все встраивания

Disallow: */wlwmanifest.xml # xml-файл манифеста Windows Live Writer (если не используете, правило можно удалить)

Disallow: /xmlrpc.php # файл WordPress API

Disallow: *utm*= # ссылки с utm-метками

Disallow: *openstat= # ссылки с метками openstat

Allow: */uploads # открываем папку с файлами uploads

User-agent: GoogleBot # правила для Google (комментарии не дублирую)

Disallow: /cgi-bin

Disallow: /?

Disallow: /wp-

Disallow: /wp/

Disallow: *?s=

Disallow: *&s=

Disallow: /search/

Disallow: /author/

Disallow: /users/

Disallow: */trackback

Disallow: */feed

Disallow: */rss

Disallow: */embed

Disallow: */wlwmanifest.xml

Disallow: /xmlrpc.php

Disallow: *utm*=

Disallow: *openstat=

Allow: */uploads

Allow: /*/*.js # открываем js-скрипты внутри /wp- (/*/ - для приоритета)

Allow: /*/*.css # открываем css-файлы внутри /wp- (/*/ - для приоритета)

Allow: /wp-*.png # картинки в плагинах, cache папке и т.д.

Allow: /wp-*.jpg # картинки в плагинах, cache папке и т.д.

Allow: /wp-*.jpeg # картинки в плагинах, cache папке и т.д.

Allow: /wp-*.gif # картинки в плагинах, cache папке и т.д.

Allow: /wp-admin/admin-ajax.php # используется плагинами, чтобы не блокировать JS и CSS

User-agent: Yandex # правила для Яндекса (комментарии не дублирую)

Disallow: /cgi-bin

Disallow: /?

Disallow: /wp-

Disallow: /wp/

Disallow: *?s=

Disallow: *&s=

Disallow: /search/

Disallow: /author/

Disallow: /users/

Disallow: */trackback

Disallow: */feed

Disallow: */rss

Disallow: */embed

Disallow: */wlwmanifest.xml

Disallow: /xmlrpc.php

Allow: */uploads

Allow: /*/*.js

Allow: /*/*.css

Allow: /wp-*.png

Allow: /wp-*.jpg

Allow: /wp-*.jpeg

Allow: /wp-*.gif

Allow: /wp-admin/admin-ajax.php

Clean-Param: utm_source&utm_medium&utm_campaign # Яндекс рекомендует не закрывать

# от индексирования, а удалять параметры меток,

# Google такие правила не поддерживает

Clean-Param: openstat # аналогично

# Укажите один или несколько файлов Sitemap (дублировать для каждого User-agent не нужно). Google XML Sitemap создает 2 карты сайта, как в примере ниже.

Sitemap: http://instaseo.ru/sitemap.xml

Sitemap: http://instaseo.ru/sitemap.xml.gz

# Host прописывать больше не нужно.

Оптимальный Robots.txt для WooCommerce

Владельцы интернет-магазинов, использующих платформу WordPress с расширением WooCommerce, также должны уделить внимание настройке файла robots.txt. Это позволит эффективно управлять индексацией различных частей магазина. Например, мы можем исключить из индексации страницу корзины, страницу оформления заказа и ссылки, которые предназначены для добавления товаров в корзину.

User-agent: *

Disallow: /cgi-bin

Disallow: /?

Disallow: /wp-

Disallow: /wp/

Disallow: *?s=

Disallow: *&s=

Disallow: /search/

Disallow: /author/

Disallow: /users/

Disallow: */trackback

Disallow: */feed

Disallow: */rss

Disallow: */embed

Disallow: */wlwmanifest.xml

Disallow: /xmlrpc.php

Disallow: *utm*=

Disallow: *openstat=

Disallow: /cart/

Disallow: /checkout/

Disallow: /*add-to-cart=*

Allow: */uploads

Allow: /*/*.js

Allow: /*/*.css

Allow: /wp-*.png

Allow: /wp-*.jpg

Allow: /wp-*.jpeg

Allow: /wp-*.gif

Allow: /wp-admin/admin-ajax.php

Sitemap: https://instaseo.ru/sitemap_index.xml

Где находится файл robots.txt в WordPress

Обычно robots.txt располагается в корневом каталоге сайта. Если его там нет, будет необходимо создать текстовый документ и загрузить его на сайт по FTP или панель управления на хостинге. Если вам не удалось найти robots.txt в корне сайта, но при переходе по ссылке вашсайт.ру/robots.txt он открывается, значит он был сгенерирован автоматически каким-либо SEO плагином.

Например, плагин Yoast SEO создает виртуальный файл, который вы не увидите в корне сайта.

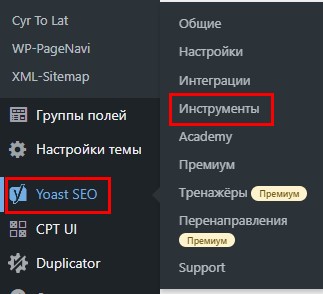

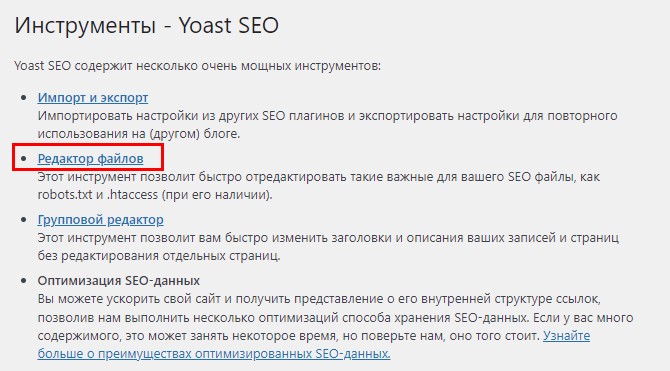

Как редактировать robots.txt с помощью Yoast SEO

- Зайдите в админ панель сайта

- Слева в консоли наведите на кнопку «Yoast SEO» и в выпадающем окне нажмите «Инструменты». Перейдите в раздел, как показано на скриншоте.

- Зайдите в редактор файлов

- Если файла robots.txt нет, нажмите на кнопку создать, либо вставьте необходимое содержимое.

- Сохраните изменения в robots.txt

Админ панель находится по следующему адресу вашсайт.ру/wp-admin/

Этот инструмент позволит быстро отредактировать такие важные для вашего SEO файлы, как robots.txt и .htaccess (при его наличии).

Содержимое файла для WordPress и WooCommerce можно взять из вышеприведенных примеров.

После сохранения файла вы можете проверить корректность через соответствующие сервисы.

Правильный файл robots.txt для Bitrix

Если ваш сайт работает на платформе Битрикс, то существует ряд потенциальных проблем, которые могут возникнуть:

- Возможно, большое количество служебных страниц будет попадать в поисковую выдачу, что может негативно сказаться на пользовательском опыте и SEO.

- Также ситуацией может быть индексация дублирующихся страниц сайта, что приводит к потере уникальности и к снижению позиций в результатах поиска.

Чтобы предотвратить подобные проблемы, которые могут повлиять на видимость вашего сайта в поисковых системах, крайне важно правильно настроить файл robots.txt. Ниже приведен пример файла robots.txt для CMS 1C-Bitrix:

User-Agent: Yandex

Disallow: */index.php

Disallow: /bitrix/

Disallow: /brands/

Disallow: /*show_include_exec_time=

Disallow: /*show_page_exec_time=

Disallow: /*show_sql_stat=

Disallow: /*bitrix_include_areas=

Disallow: /*clear_cache=

Disallow: /*clear_cache_session=

Disallow: /*ADD_TO_COMPARE_LIST

Disallow: /*ORDER_BY

Disallow: /*?print=

Disallow: /*&print=

Disallow: /*print_course=

Disallow: /razdely-konditsionerov/

Disallow: /*?action=

Disallow: /*&action=

Disallow: /*register=

Disallow: /*forgot_password=

Disallow: /*change_password=

Disallow: /*login=

Disallow: /*logout=

Disallow: /*auth=

Disallow: /*backurl=

Disallow: /*back_url=

Disallow: /*BACKURL=

Disallow: /*BACK_URL=

Disallow: /*back_url_admin=

Disallow: /*?utm_source=

Disallow: /*?bxajaxid=

Disallow: /*&bxajaxid=

Disallow: /*?alfaction=

Disallow: /*?set_filter=

Disallow: /*?sphrase_id=*

Disallow: /*?success=*

Disallow: /*?SECTION_CODE=*

Disallow: */detail?ID=

Disallow: */list.php

Disallow: *?SECTION_ID=

Disallow: *?arrFilter

Disallow: /catalog/compare

Disallow: */filter

Disallow: /upload/resize_cache/

Disallow: /private-policy

Disallow: /search*

Disallow: /personal/

Disallow: /*?view=*

Disallow: /*?search=*

Disallow: *?*

Disallow: /*?year=*

Disallow: /*?offer=*

Allow: /bitrix/templates/

Allow: */upload/

Allow: /bitrix/*.js

Allow: /bitrix/*.css

Allow: /local/*.js

Allow: /local/*.css

Allow: /local/*.jpg

Allow: /local/*.jpeg

Allow: /local/*.png

Allow: /local/*.gif

Sitemap: https://aklimat.su/sitemap.xml

User-Agent: *

Disallow: */index.php

Disallow: /bitrix/

Disallow: /brands/

Disallow: /*show_include_exec_time=

Disallow: /*show_page_exec_time=

Disallow: /*show_sql_stat=

Disallow: /*bitrix_include_areas=

Disallow: /*clear_cache=

Disallow: /*clear_cache_session=

Disallow: /*ADD_TO_COMPARE_LIST

Disallow: /*ORDER_BY

Disallow: /*?print=

Disallow: /*&print=

Disallow: /*print_course=

Disallow: /razdely-konditsionerov/

Disallow: /*?action=

Disallow: /*&action=

Disallow: /*register=

Disallow: /*forgot_password=

Disallow: /*change_password=

Disallow: /*login=

Disallow: /*logout=

Disallow: /*auth=

Disallow: /*backurl=

Disallow: /*back_url=

Disallow: /*BACKURL=

Disallow: /*BACK_URL=

Disallow: /*back_url_admin=

Disallow: /*?utm_source=

Disallow: /*?bxajaxid=

Disallow: /*&bxajaxid=

Disallow: /*?alfaction=

Disallow: /*?set_filter=

Disallow: /*?sphrase_id=*

Disallow: /*?success=*

Disallow: /*?SECTION_CODE=*

Disallow: */detail?ID=

Disallow: */list.php

Disallow: *?SECTION_ID=

Disallow: *?arrFilter

Disallow: /catalog/compare

Disallow: */filter

Disallow: /upload/resize_cache/

Disallow: /private-policy

Disallow: /search*

Disallow: /personal/

Disallow: /*?view=*

Disallow: /*?search=*

Disallow: *?*

Disallow: /*?year=*

Disallow: /*?offer=*

Allow: /bitrix/templates/

Allow: */upload/

Allow: /bitrix/*.js

Allow: /bitrix/*.css

Allow: /local/*.js

Allow: /local/*.css

Allow: /local/*.jpg

Allow: /local/*.jpeg

Allow: /local/*.png

Allow: /local/*.gif

Sitemap: https://aklimat.su/sitemap.xml

User-Agent: Googlebot

Disallow: */index.php

Disallow: /bitrix/

Disallow: /brands/

Disallow: /*show_include_exec_time=

Disallow: /*show_page_exec_time=

Disallow: /*show_sql_stat=

Disallow: /*bitrix_include_areas=

Disallow: /*clear_cache=

Disallow: /*clear_cache_session=

Disallow: /*ADD_TO_COMPARE_LIST

Disallow: /*ORDER_BY

Disallow: /*?print=

Disallow: /*&print=

Disallow: /*print_course=

Disallow: /razdely-konditsionerov/

Disallow: /*?action=

Disallow: /*&action=

Disallow: /*register=

Disallow: /*forgot_password=

Disallow: /*change_password=

Disallow: /*login=

Disallow: /*logout=

Disallow: /*auth=

Disallow: /*backurl=

Disallow: /*back_url=

Disallow: /*BACKURL=

Disallow: /*BACK_URL=

Disallow: /*back_url_admin=

Disallow: /*?utm_source=

Disallow: /*?bxajaxid=

Disallow: /*&bxajaxid=

Disallow: /*?alfaction=

Disallow: /*?set_filter=

Disallow: /*?sphrase_id=*

Disallow: /*?success=*

Disallow: /*?SECTION_CODE=*

Disallow: */detail?ID=

Disallow: */list.php

Disallow: *?SECTION_ID=

Disallow: *?arrFilter

Disallow: /catalog/compare

Disallow: */filter

Disallow: /upload/resize_cache/

Disallow: /private-policy

Disallow: /search*

Disallow: /personal/

Disallow: /*?view=*

Disallow: /*?search=*

Disallow: *?*

Disallow: /*?year=*

Disallow: /*?offer=*

Allow: /bitrix/templates/

Allow: */upload/

Allow: /bitrix/*.js

Allow: /bitrix/*.css

Allow: /local/*.js

Allow: /local/*.css

Allow: /local/*.jpg

Allow: /local/*.jpeg

Allow: /local/*.png

Allow: /local/*.gif

Sitemap: https://aklimat.su/sitemap.xml

Пример настройки роботс для OpenCart

Правильный файл robots.txt для OpenCart должен быть разработан с учетом особенностей данной платформы:

User-agent: Yandex

Disallow: /*route=account/

Disallow: /*route=affiliate/

Disallow: /*route=checkout/

Disallow: /*route=product/search

Disallow: /index.php

Disallow: /admin

Disallow: /catalog

Disallow: /download

Disallow: /export

Disallow: /system

Disallow: /*?sort=

Disallow: /*&sort=

Disallow: /*?order=

Disallow: /*&order=

Disallow: /*?limit=

Disallow: /*&limit=

Disallow: /*?filter_name=

Disallow: /*&filter_name=

Disallow: /*?filter_sub_category=

Disallow: /*&filter_sub_category=

Disallow: /*?filter_description=

Disallow: /*&filter_description=

Disallow: /*?tracking=

Disallow: /*&tracking=

Disallow: /*?page=

Disallow: /*&page=

Disallow: /wishlist

Disallow: /login

User-agent: Googlebot

Disallow: /*route=account/

Disallow: /*route=affiliate/

Disallow: /*route=checkout/

Disallow: /*route=product/search

Disallow: /index.php

Disallow: /admin

Disallow: /catalog

Disallow: /download

Disallow: /export

Disallow: /system

Disallow: /*?sort=

Disallow: /*&sort=

Disallow: /*?order=

Disallow: /*&order=

Disallow: /*?limit=

Disallow: /*&limit=

Disallow: /*?filter_name=

Disallow: /*&filter_name=

Disallow: /*?filter_sub_category=

Disallow: /*&filter_sub_category=

Disallow: /*?filter_description=

Disallow: /*&filter_description=

Disallow: /*?tracking=

Disallow: /*&tracking=

Disallow: /*?page=

Disallow: /*&page=

Disallow: /wishlist

Disallow: /login

Allow: *.css

Allow: *.js

User-agent: *

Disallow: /*route=account/

Disallow: /*route=affiliate/

Disallow: /*route=checkout/

Disallow: /*route=product/search

Disallow: /index.php

Disallow: /admin

Disallow: /catalog

Disallow: /download

Disallow: /export

Disallow: /system

Disallow: /*?sort=

Disallow: /*&sort=

Disallow: /*?order=

Disallow: /*&order=

Disallow: /*?limit=

Disallow: /*&limit=

Disallow: /*?filter_name=

Disallow: /*&filter_name=

Disallow: /*?filter_sub_category=

Disallow: /*&filter_sub_category=

Disallow: /*?filter_description=

Disallow: /*&filter_description=

Disallow: /*?tracking=

Disallow: /*&tracking=

Disallow: /*?page=

Disallow: /*&page=

Disallow: /wishlist

Disallow: /login

Sitemap: http://вашсайт.ру/sitemap.xml

Пример настройки роботс для Umi.CMS

Оптимальный файл robots.txt для Umi CMS должен быть настроен с учетом специфики данной платформы, чтобы избежать проблем с дублированием страниц и обеспечить более эффективную индексацию:

User-Agent: Yandex

Disallow: /?

Disallow: /emarket/addToCompare

Disallow: /emarket/basket

Disallow: /go_out.php

Disallow: /images

Disallow: /files

Disallow: /users

Disallow: /admin

Disallow: /search

Disallow: /install-temp

Disallow: /install-static

Disallow: /install-libs

User-Agent: Googlebot

Disallow: /?

Disallow: /emarket/addToCompare

Disallow: /emarket/basket

Disallow: /go_out.php

Disallow: /images

Disallow: /files

Disallow: /users

Disallow: /admin

Disallow: /search

Disallow: /install-temp

Disallow: /install-static

Disallow: /install-libs

Allow: *.css

Allow: *.js

User-Agent: *

Disallow: /?

Disallow: /emarket/addToCompare

Disallow: /emarket/basket

Disallow: /go_out.php

Disallow: /images

Disallow: /files

Disallow: /users

Disallow: /admin

Disallow: /search

Disallow: /install-temp

Disallow: /install-static

Disallow: /install-libs

Sitemap: http://вашсайт.ру/sitemap.xml

Пример настройки роботс для Joomla

Для сайтов, использующих CMS Джумла, рекомендуется создавать правильный файл robots.txt с учетом особенностей данной платформы. Это поможет эффективно управлять индексацией и избежать некоторых распространенных проблем:

User-agent: Yandex

Disallow: /administrator/

Disallow: /cache/

Disallow: /components/

Disallow: /component/

Disallow: /includes/

Disallow: /installation/

Disallow: /language/

Disallow: /libraries/

Disallow: /media/

Disallow: /modules/

Disallow: /plugins/

Disallow: /templates/

Disallow: /tmp/

Disallow: /*?start=*

Disallow: /xmlrpc/

User-agent: Googlebot

Disallow: /administrator/

Disallow: /cache/

Disallow: /components/

Disallow: /component/

Disallow: /includes/

Disallow: /installation/

Disallow: /language/

Disallow: /libraries/

Disallow: /media/

Disallow: /modules/

Disallow: /plugins/

Disallow: /templates/

Disallow: /tmp/

Disallow: /*?start=*

Disallow: /xmlrpc/

Allow: *.css

Allow: *.js

User-agent: *

Disallow: /administrator/

Disallow: /cache/

Disallow: /components/

Disallow: /component/

Disallow: /includes/

Disallow: /installation/

Disallow: /language/

Disallow: /libraries/

Disallow: /media/

Disallow: /modules/

Disallow: /plugins/

Disallow: /templates/

Disallow: /tmp/

Disallow: /*?start=*

Disallow: /xmlrpc/

Sitemap: http://sitevam.com/sitemap.xml

Часто задаваемые вопросы

1. Как проверить правильность работы robots.txt?

У Google и Яндекс есть средства для проверки файла robots.txt:

Яндекс – https://webmaster.yandex.ru/tools/robotstxt/

Google – https://support.google.com/webmasters/answer/6062598?hl=ru

2. Закрывать ли feed в robots.txt?

По умолчанию мы рекомендуем закрывать feed от индексации в robots.txt. Открытие feed может потребоваться, если вы например настраиваете Турбо-

страницы от Яндекса или выгружаете свою ленту в другой сервис.

3. Как разрешить индексировать feed Турбо-страниц?

Добавьте следующую директиву, чтобы Яндекс смог проверять ваши турбо-страницы и обновлять их:

Allow: /feed/turbo/